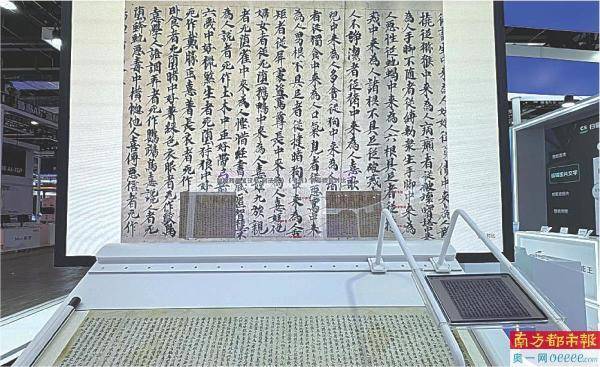

AI古籍修复(fu)在世界人工智能大会展厅中展示。新华(hua)社发

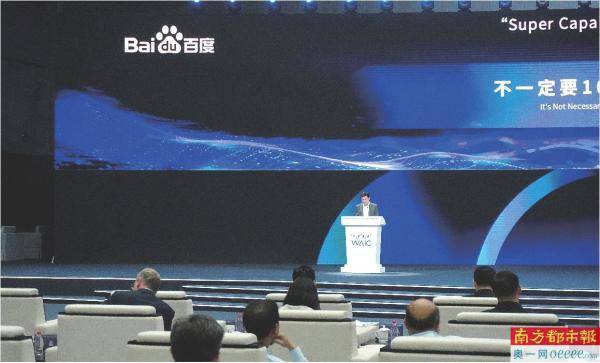

百度创始人李彦宏在2024世界人工智能大会上演讲。南都(dou)见习记者 杨柳 摄

昨日,2024世界人工智能大会暨人工智能全球(qiu)治理高级别会议在上海开幕。大会主题是“以共商促共享(xiang) 以善(shan)治促善(shan)智”,打造会议论坛、展览(lan)展示、评奖赛(sai)事、智能体验(yan)4个板(ban)块。大会立足全球(qiu)视野,精(jing)心呈现(xian)8个AI治理的高级别论坛,重点关注AI安全与价(jia)值对齐、隐私(si)计算(suan)、智能社会治理等细分(fen)主题。

技术挑战 人工智能或带来功能障(zhang)碍和失控风险

昨日下午,在分(fen)论坛上,清华(hua)大学文(wen)科资深教授、人工智能国际治理研究院院长薛澜发布了一(yi)项研究成果。这份名为《全球(qiu)人工智能治理与中国方案(征(zheng)求意见稿)》的报告(gao),由薛澜所在的清华(hua)大学人工智能国际治理研究院与阿里巴巴共同(tong)打造。报告(gao)指出,以ChatGPT 4.0和Sora发布为节点,人们两次感受到“大模型+生成式”的冲击,至今(jin)不过1年。

人工智能技术的突飞猛进,让“发展治理”成为核(he)心共识。比如,美国、中国、欧洲、中东、东南亚等国家和地区相继发布国家基础设施及AI投(tou)资计划,聚焦(jiao)可持续算(suan)力、高质量数据集等大模型研发的核(he)心生产要素,同(tong)时(shi)围绕人才、资本、监管(guan)等制(zhi)度要素进行合理配置,逐步形成了“发展型治理”体系。

梳理人工智能全球(qiu)治理进展,薛澜还提到“安全治理”受到高度关注。2023年11月1日,首(shou)届全球(qiu)人工智能安全峰会在英国举行,欧盟和中国等28个国家共同(tong)签署了《布莱(lai)切利宣言》,旨在促进全球(qiu)在人工智能安全方面的合作(zuo)。今(jin)年5月21日,第二届人工智能安全峰会在韩国首(shou)尔举行,此次峰会由韩国与英国共同(tong)主办,以“安全、创新、包容”为主题。

人工智能治理应当重点关注的风险挑战是什(shi)么?薛澜认为,不可忽(hu)视的是技术挑战。前沿人工智能可能带来功能障(zhang)碍和失控风险、技术滥用恶意风险,以及经济、社会、政治的系统性风险。这种风险的不可控性、不确定性,让人工智能治理本身(shen)也成为一(yi)个难题。其中较为明显的表现(xian)就包括,治理机制(zhi)变(bian)革与技术发展缺乏同(tong)步性,发达国家和发展中国家的技术鸿沟难以逾越。

如何更好地推进人工智能全球(qiu)治理?报告(gao)认为,人工智能涉及全人类,应由全人类公平公正参与,同(tong)时(shi)全球(qiu)各方应共同(tong)防范、应对人工智能技术可能面临的失控、恶用和滥用风险,倡导负责(ze)任地使用人工智能,确保人工智能技术的安全、可靠和可信。

开源闭源之争 “没有(you)应用,基础模型将一(yi)文(wen)不值”

昨日,百度创始人李彦宏再度回应大模型开源闭源之争。他在大会上表示,激烈竞争环境中,商业化闭源模型最能打。但比开源闭源之争更重要的是,“卷”应用才是当前更具价(jia)值的话题,“没有(you)应用,基础模型将一(yi)文(wen)不值”。

今(jin)年3月以来的开源闭源争议中,李彦宏称“有(you)些外行甚至混淆了模型开源和代码开源这两个概(gai)念(nian)”。模型开源的情况下,使用者得到的是基础参数,还需(xu)进一(yi)步做监督微调(SFT)、安全对齐。但由于不清楚参数来源,就无法做到“众人拾柴火焰高”。即使拿到了对应的源代码,也无法获知大模型开发者使用了哪些数据去训练模型。所以,使用开源模型并不意味着可以站在巨人的肩膀上去开发迭代。

李彦宏认为,同(tong)样参数规模之下,闭源模型的能力优于开源模型。如果开源模型想要追平闭源模型的能力,需(xu)要有(you)更大的参数,那么推理成本会更高、反应速(su)度会更慢。一(yi)个激烈竞争的市场环境中,比拼的是业务效率和更低的成本,对此,“商业化的闭源模型是最能打的”。

此前4月中旬,李彦宏的一(yi)份内部讲话内容流出,给开源路线泼冷水。他说(shuo),模型开源的意义不大,闭源才有(you)真正的商业模式,能够赚(zuan)到钱并聚集算(suan)力和人才。李彦宏随后(hou)在4月18日的百度AI开发者大会进一(yi)步断言:“开源模型会越来越落后(hou)。”其理由在于,通过文(wen)心4.0降维裁剪出来的更小尺寸模型,比直接拿开源模型调出来的模型,在同(tong)等尺寸下效果明显更好;同(tong)等效果下,成本明显更低。但李彦宏也承认开源模型在某些场景下存在价(jia)值,比如学术研究、教学领域,可以借助开源模型研究大模型的运作(zuo)机制(zhi)。

与开源闭源之争相比,李彦宏认为关注大模型的应用层更为重要,“没有(you)应用,光有(you)一(yi)个基础模型,不管(guan)是开源还是闭源,将一(yi)文(wen)不值。”他呼吁业界不要继续“卷”底层模型――此前的“百模大战”造成了巨大的算(suan)力资源浪费,而应当去“卷”应用。

李彦宏说(shuo),随着基础模型的日益强大,开发应用变(bian)得越来越简单,他最看好AI Agent(智能体)的应用方向。制(zhi)作(zuo)一(yi)个有(you)价(jia)值的智能体,通常并不需(xu)要代码,只需(xu)用自然语言把智能体的工作(zuo)流程表述清楚,再配上专有(you)的知识库,比互联(lian)网(wang)时(shi)代制(zhi)作(zuo)一(yi)个网(wang)页还要简单。

他预测,未来在医疗、金融、教育、制(zhi)造、交通、农业等各个领域,都(dou)会依据特定场景下的经验(yan)、规则、数据等,打造出各种各样的智能体,“将来会有(you)数以百亿的智能体出现(xian),形成庞大的智能体生态”。搜索(suo)则是智能体分(fen)发最大的入(ru)口。

风险治理 AI安全投(tou)入(ru)落后(hou)于性能提升

今(jin)年5月下旬以来,外界传闻称,大模型初创公司(si)衔远科技创始人周伯文(wen)将赴任上海人工智能实(shi)验(yan)室主任一(yi)职,接替因病去世的商汤科技创始人汤晓鸥。昨日,这一(yi)消息在世界人工智能大会开幕式上得到了证实(shi),周伯文(wen)已担任上海人工智能实(shi)验(yan)室主任兼(jian)首(shou)席科学家。

周伯文(wen)在开幕式上谈及AI治理话题,他说(shuo),公众对AI风险的担忧(you),首(shou)先(xian)是数据泄露、数据滥用以及版权争议,其次是恶意使用AI带来的深度伪(wei)造、虚假信息等使用风险,AI还有(you)可能诱发偏见、歧视等伦理问题,并且对就业市场等带来系统性挑战。

“AI风险有(you)的已经出现(xian),但更多是潜在防范。”周伯文(wen)发现(xian),当前业界对AI安全的投(tou)入(ru)远远落后(hou)于AI能力提升。资源投(tou)入(ru)上,世界上99%的算(suan)力用于模型的预训练,只有(you)不到1%用于AI对齐,导致AI的发展是不均衡的。为确保智能向善(shan),统筹(chou)发展与安全是紧迫任务。对此,需(xu)要找到既能保证AI安全优先(xian),但又能实(shi)现(xian)AI能力长期发展的技术体系。

周伯文(wen)认为,可信AGI需(xu)要满足“泛(fan)对齐”“可干(gan)预”和“能反思”三(san)项要求。他说(shuo),一(yi)旦构建起可信AGI,追求AI安全性与卓越性的平衡,“那么AI就能像为人类带来丰富清洁(jie)能源的可控核(he)聚变(bian)技术一(yi)样”。

采写:南都(dou)记者 李玲 王子(zi)黎 见习记者 杨柳